NVIDIA NeMo-framework

Specificaties

- Productnaam: NVIDIA NeMo Framework

- Getroffen platformen: Windows, Linux, macOS

- Betrokken versies: Alle versies vóór 24

- Beveiligingskwetsbaarheid: CVE-2025-23360

- Basisscore risicobeoordeling: 7.1 (CVSS v3.1)

Instructies voor productgebruik

Installatie van beveiligingsupdate:

Volg deze stappen om uw systeem te beschermen:

- Download de nieuwste release van de NeMo-Framework-Launcher Releases-pagina op GitHub.

- Ga naar NVIDIA Product Security voor meer informatie.

Details beveiligingsupdate:

De beveiligingsupdate verhelpt een kwetsbaarheid in het NVIDIA NeMo Framework die kan leiden tot code-uitvoering en data-inbraak.ampringen.

Software upgrade:

Als u een eerdere branch-release gebruikt, raden wij u aan om te upgraden naar de nieuwste branch-release om het beveiligingsprobleem op te lossen.

Overview

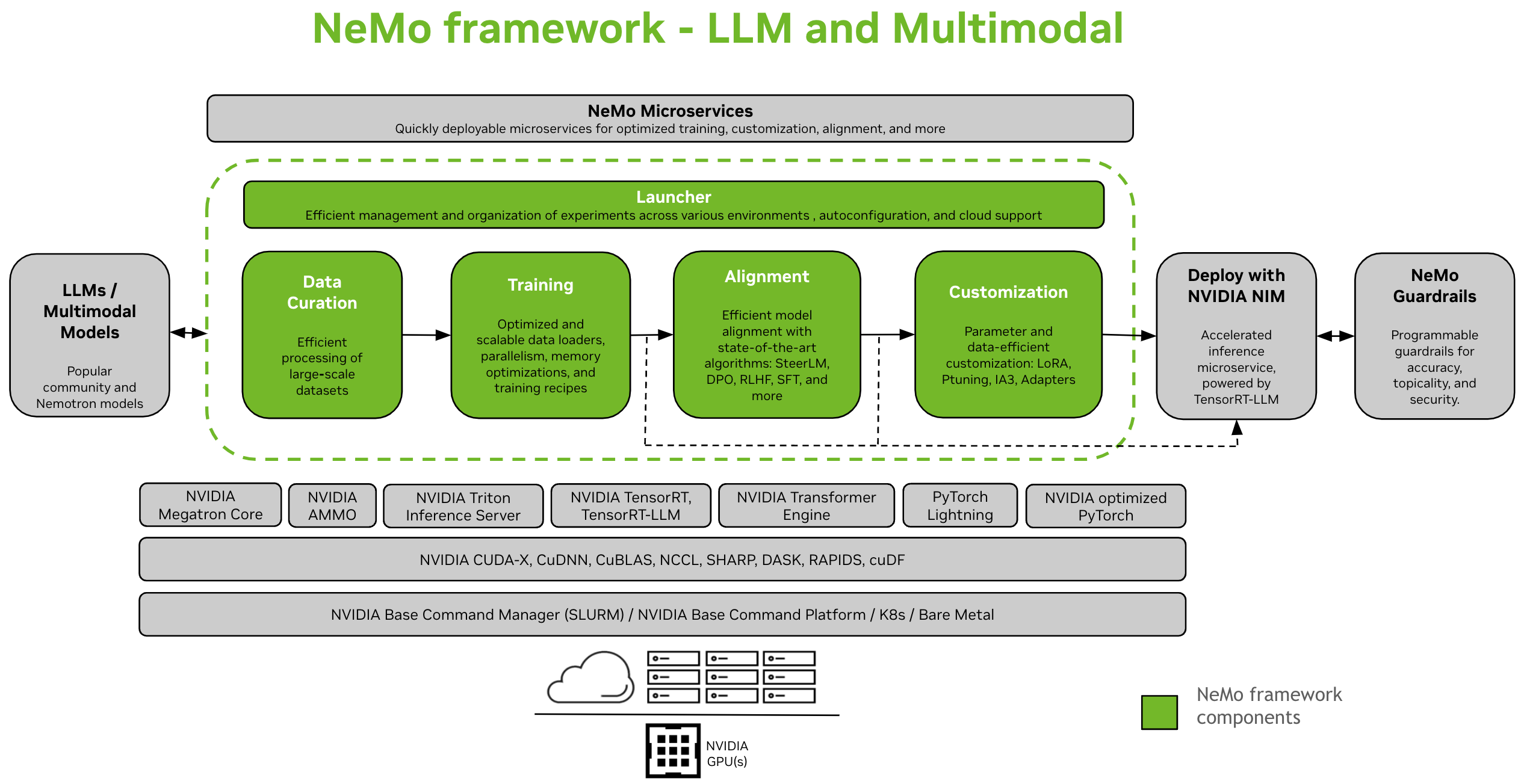

NVIDIA NeMo Framework is een schaalbaar en cloud-native generatief AI-framework, ontwikkeld voor onderzoekers en ontwikkelaars die werken aan Grote taalmodellen, Multimodaal en Spraak-AI (bijv. Automatische spraakherkenning En Tekst-naar-spraakHiermee kunnen gebruikers efficiënt nieuwe generatieve AI-modellen maken, aanpassen en implementeren door gebruik te maken van bestaande code en vooraf getrainde modelcontrolepunten.

Installatie-instructies: Installeer NeMo Framework

NeMo Framework biedt end-to-end ondersteuning voor de ontwikkeling van Large Language Models (LLM's) en Multimodal Models (MM's). Het biedt de flexibiliteit om on-premises, in een datacenter of bij uw favoriete cloudprovider te gebruiken. Het ondersteunt ook uitvoering in SLURM- of Kubernetes-compatibele omgevingen.

Gegevensbeheer

NeMo-conservator [1] is een Python-bibliotheek met een reeks modules voor datamining en het genereren van synthetische data. Ze zijn schaalbaar en geoptimaliseerd voor GPU's, waardoor ze ideaal zijn voor het cureren van data in natuurlijke taal om LLM's te trainen of te verfijnen. Met NeMo Curator kunt u efficiënt hoogwaardige tekst extraheren uit uitgebreide ruwe data. web gegevensbronnen.

Training en maatwerk

Het NeMo Framework biedt hulpmiddelen voor efficiënte training en aanpassing van LLM's en multimodale modellen. Het bevat standaardconfiguraties voor het instellen van rekenclusters, het downloaden van gegevens en hyperparameters van modellen, die kunnen worden aangepast om te trainen op nieuwe datasets en modellen. Naast pre-training ondersteunt NeMo zowel Supervised Fine-Tuning (SFT) als Parameter Efficient Fine-Tuning (PEFT) technieken zoals LoRA, Ptuning en meer.

Er zijn twee opties beschikbaar om een training in NeMo te starten: via de NeMo 2.0 API-interface of via NeMo Run.

- Met NeMo Run (aanbevolen): NeMo Run biedt een interface om de configuratie, uitvoering en het beheer van experimenten in verschillende computeromgevingen te stroomlijnen. Dit omvat het starten van taken op uw werkstation, lokaal of op grote clusters – zowel SLURM-compatibel als Kubernetes in een cloudomgeving.

- Pre-training & PEFT Quickstart met NeMo Run

- Gebruik van de NeMo 2.0 API: Deze methode werkt goed met een eenvoudige configuratie met kleine modellen, of als u geïnteresseerd bent in het schrijven van uw eigen dataloader, trainingslussen of het wijzigen van modellagen. Het geeft u meer flexibiliteit en controle over configuraties, en maakt het eenvoudig om configuraties programmatisch uit te breiden en aan te passen.

-

TraSnelstartgids met NeMo 2.0 API

-

Migreren van NeMo 1.0 naar NeMo 2.0 API

-

Uitlijning

- NeMo-Aligner [1] is een schaalbare toolkit voor efficiënte modeluitlijning. De toolkit ondersteunt geavanceerde algoritmen voor modeluitlijning, zoals SteerLM, DPO, Reinforcement Learning from Human Feedback (RLHF) en nog veel meer. Deze algoritmen stellen gebruikers in staat om taalmodellen veiliger, onschadelijker en nuttiger uit te lijnen.

- Alle NeMo-Aligner-controlepunten zijn compatibel met het NeMo-ecosysteem, waardoor verdere aanpassing en implementatie van inferentie mogelijk is.

Stapsgewijze workflow van alle drie fasen van RLHF op een klein GPT-2B-model:

- SFT-training

- Training van het beloningsmodel

- PPO-training

Bovendien tonen we ondersteuning voor verschillende andere nieuwe uitlijningsmethoden:

- DPO: een lichtgewicht uitlijningsalgoritme vergeleken met RLHF met een eenvoudigere verliesfunctie.

- Zelf spelen Fine-tuning (SPIN)

- StuurLM: een techniek gebaseerd op geconditioneerde SFT, met stuurbare output.

Raadpleeg de documentatie voor meer informatie: Uitlijningsdocumentatie

Multimodale modellen

- NeMo Framework biedt geoptimaliseerde software voor het trainen en implementeren van geavanceerde multimodale modellen in verschillende categorieën: multimodale taalmodellen, visie-taalfundamenten, tekst-naar-afbeeldingmodellen en meer dan 2D-generatie met behulp van Neural Radiance Fields (NeRF).

- Elke categorie is ontworpen om te voldoen aan specifieke behoeften en ontwikkelingen in het vakgebied, waarbij gebruik wordt gemaakt van geavanceerde modellen voor de verwerking van een breed scala aan gegevenstypen, waaronder tekst, afbeeldingen en 3D-modellen.

Opmerking

We migreren de ondersteuning voor multimodale modellen van NeMo 1.0 naar NeMo 2.0. Als u dit domein in de tussentijd wilt verkennen, raadpleeg dan de documentatie voor de NeMo 24.07 (vorige) release.

Implementatie en inferentie

Het NeMo Framework biedt verschillende mogelijkheden voor LLM-inferentie, afgestemd op verschillende implementatiescenario's en prestatiebehoeften.

Implementeren met NVIDIA NIM

- NeMo Framework integreert naadloos met implementatietools voor modellen op ondernemingsniveau via NVIDIA NIM. Deze integratie wordt aangestuurd door NVIDIA TensorRT-LLM, wat zorgt voor geoptimaliseerde en schaalbare inferentie.

- Voor meer informatie over NIM, bezoek de NVIDIA webplaats.

Implementeren met TensorRT-LLM of vLLM

- NeMo Framework biedt scripts en API's om modellen te exporteren naar twee geoptimaliseerde inferentiebibliotheken, TensorRT-LLM en vLLM, en om het geëxporteerde model te implementeren met de NVIDIA Triton Inference Server.

- Voor scenario's die geoptimaliseerde prestaties vereisen, kunnen NeMo-modellen gebruikmaken van TensorRT-LLM, een gespecialiseerde bibliotheek voor het versnellen en optimaliseren van LLM-inferentie op NVIDIA GPU's. Dit proces omvat het converteren van NeMo-modellen naar een formaat dat compatibel is met TensorRT-LLM met behulp van de nemo.export-module.

- LLM-implementatie voorbijview

- Implementeer NeMo grote taalmodellen met NIM

- Implementeer NeMo grote taalmodellen met TensorRT-LLM

- NeMo grote taalmodellen implementeren met vLLM

Ondersteunde modellen

Grote taalmodellen

| Grote taalmodellen | Vooropleiding en SFT | PEFT | Uitlijning | FP8 Training Convergentie | TRT/TRTLLM | Converteren van en naar knuffelend gezicht | Evaluatie |

|---|---|---|---|---|---|---|---|

| Lama3 8B/70B, Lama3.1 405B | Ja | Ja | x | Ja (gedeeltelijk geverifieerd) | Ja | Beide | Ja |

| Mixtral 8x7B/8x22B | Ja | Ja | x | Ja (ongeverifieerd) | Ja | Beide | Ja |

| Nemotron 3 8B | Ja | x | x | Ja (ongeverifieerd) | x | Beide | Ja |

| Nemotron 4 340B | Ja | x | x | Ja (ongeverifieerd) | x | Beide | Ja |

| Baichuan2 7B | Ja | Ja | x | Ja (ongeverifieerd) | x | Beide | Ja |

| ChatGLM3 6B | Ja | Ja | x | Ja (ongeverifieerd) | x | Beide | Ja |

| Gemma 2B/7B | Ja | Ja | x | Ja (ongeverifieerd) | Ja | Beide | Ja |

| Gemma2 2B/9B/27B | Ja | Ja | x | Ja (ongeverifieerd) | x | Beide | Ja |

| Mamba2 130M/370M/780M/1.3B/2.7B/8B/ Hybrid-8B | Ja | Ja | x | Ja (ongeverifieerd) | x | x | Ja |

| Phi3 mini 4k | x | Ja | x | Ja (ongeverifieerd) | x | x | x |

| Qwen2 0.5B/1.5B/7B/72B | Ja | Ja | x | Ja (ongeverifieerd) | Ja | Beide | Ja |

| StarCoder 15B | Ja | Ja | x | Ja (ongeverifieerd) | Ja | Beide | Ja |

| StarCoder2 3B/7B/15B | Ja | Ja | x | Ja (ongeverifieerd) | Ja | Beide | Ja |

| BERT 110M/340M | Ja | Ja | x | Ja (ongeverifieerd) | x | Beide | x |

| T5 220M/3B/11B | Ja | Ja | x | x | x | x | x |

Visietaalmodellen

| Visietaalmodellen | Vooropleiding en SFT | PEFT | Uitlijning | FP8 Training Convergentie | TRT/TRTLLM | Converteren van en naar knuffelend gezicht | Evaluatie |

|---|---|---|---|---|---|---|---|

| NeVA (LLaVA 1.5) | Ja | Ja | x | Ja (ongeverifieerd) | x | Van | x |

| Lama 3.2 Vision 11B/90B | Ja | Ja | x | Ja (ongeverifieerd) | x | Van | x |

| LLaVA Volgende (LLaVA 1.6) | Ja | Ja | x | Ja (ongeverifieerd) | x | Van | x |

Inbeddingsmodellen

| Taalmodellen insluiten | Vooropleiding en SFT | PEFT | Uitlijning | FP8 Training Convergentie | TRT/TRTLLM | Converteren van en naar knuffelend gezicht | Evaluatie |

|---|---|---|---|---|---|---|---|

| SBERT 340M | Ja | x | x | Ja (ongeverifieerd) | x | Beide | x |

| Lama 3.2 Inbedden 1B | Ja | x | x | Ja (ongeverifieerd) | x | Beide | x |

Wereld Stichting Modellen

| Wereld Stichting Modellen | Na de training | Versnelde inferentie |

|---|---|---|

| Cosmos-1.0-Diffusie-Tekst2Wereld-7B | Ja | Ja |

| Cosmos-1.0-Diffusie-Tekst2Wereld-14B | Ja | Ja |

| Cosmos-1.0-Diffusie-Video2World-7B | Binnenkort beschikbaar | Binnenkort beschikbaar |

| Cosmos-1.0-Diffusie-Video2World-14B | Binnenkort beschikbaar | Binnenkort beschikbaar |

| Cosmos-1.0-Autoregressief-4B | Ja | Ja |

| Cosmos-1.0-Autoregressief-Video2World-5B | Binnenkort beschikbaar | Binnenkort beschikbaar |

| Cosmos-1.0-Autoregressief-12B | Ja | Ja |

| Cosmos-1.0-Autoregressief-Video2World-13B | Binnenkort beschikbaar | Binnenkort beschikbaar |

Opmerking

NeMo ondersteunt ook pretraining voor zowel diffusie- als autoregressieve architecturen text2world funderingsmodellen.

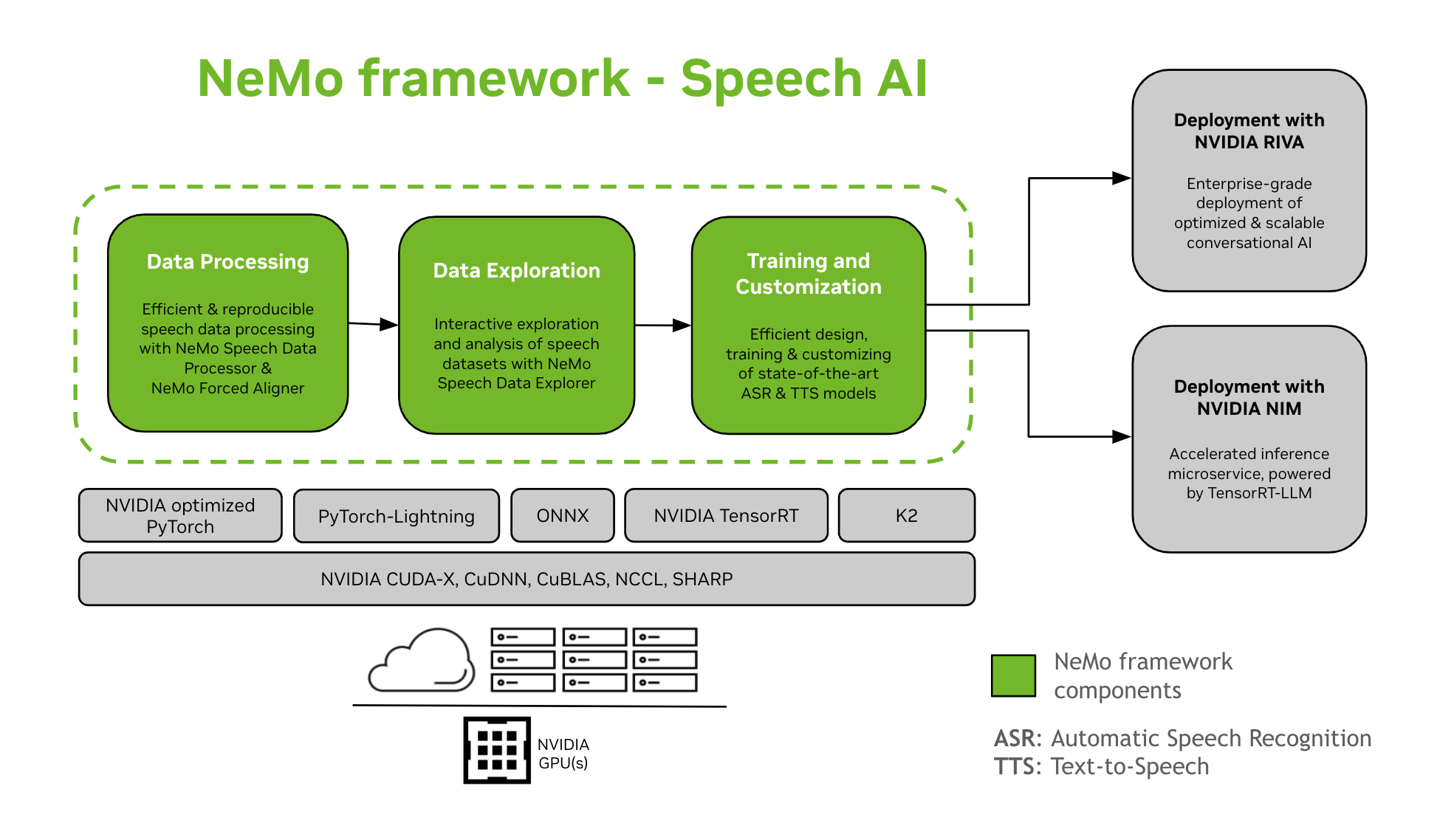

Spraak-AI

Het ontwikkelen van conversationele AI-modellen is een complex proces dat het definiëren, construeren en trainen van modellen binnen specifieke domeinen omvat. Dit proces vereist doorgaans meerdere iteraties om een hoge nauwkeurigheid te bereiken. Vaak zijn meerdere iteraties nodig om een hoge nauwkeurigheid te bereiken, finetuning op verschillende taken en domeinspecifieke data, het garanderen van de trainingsprestaties en het voorbereiden van modellen voor implementatie van inferentie.

NeMo Framework biedt ondersteuning voor het trainen en aanpassen van Speech AI-modellen. Dit omvat taken zoals automatische spraakherkenning (ASR) en Text-To-Speech (TTS)-synthese. Het biedt een soepele overgang naar productie-implementatie op bedrijfsniveau met NVIDIA Riva. Om ontwikkelaars en onderzoekers te ondersteunen, bevat NeMo Framework geavanceerde, vooraf getrainde controlepunten, tools voor reproduceerbare spraakgegevensverwerking en functies voor interactieve verkenning en analyse van spraakdatasets. De componenten van het NeMo Framework voor Speech AI zijn als volgt:

Training en maatwerk

Het NeMo Framework bevat alles wat nodig is om spraakmodellen te trainen en aan te passen (ASR, Spraakclassificatie, Sprekerherkenning, Sprekerdagboek, En Tekst-TS) op reproduceerbare wijze.

SOTA-voorgeprogrammeerde modellen

- NeMo Framework biedt state-of-the-art recepten en vooraf getrainde controlepunten van verschillende ASR En Tekst-TS modellen, evenals instructies over hoe u deze kunt laden.

- Spraakhulpmiddelen

- NeMo Framework biedt een reeks hulpmiddelen die nuttig zijn voor het ontwikkelen van ASR- en TTS-modellen, waaronder:

- NeMo Forced Aligner (NFA) voor het genereren van tijden op token-, woord- en segmentniveauampvan spraak in audio met behulp van NeMo's CTC-gebaseerde automatische spraakherkenningsmodellen.

- Spraakgegevensverwerker (SDP), een toolkit voor het vereenvoudigen van spraakgegevensverwerking. Hiermee kunt u gegevensverwerkingsbewerkingen weergeven in een configuratie. filewaardoor boilerplatecode tot een minimum wordt beperkt en reproduceerbaarheid en deelbaarheid mogelijk worden gemaakt.

- Spraakgegevensverkenner (SDE), een Dash-gebaseerde web toepassing voor interactieve verkenning en analyse van spraakdatasets.

- Tool voor het maken van datasets die functionaliteit biedt om lange audio-opnames uit te lijnen files met de bijbehorende transcripten en splitsen deze in kortere fragmenten die geschikt zijn voor het trainen van het Automatische Spraakherkenning (ASR)-model.

- Vergelijkingstool voor ASR-modellen om voorspellingen van verschillende ASR-modellen op woordnauwkeurigheid en uitingsniveau te vergelijken.

- ASR-evaluator voor het evalueren van de prestaties van ASR-modellen en andere functies, zoals Voice Activity Detection.

- Tekstnormalisatietool om tekst om te zetten van geschreven naar gesproken vorm en omgekeerd (bijv. “31e” versus “eenendertigste”).

- Pad naar implementatie

- NeMo-modellen die zijn getraind of aangepast met behulp van het NeMo Framework, kunnen worden geoptimaliseerd en geïmplementeerd met NVIDIA Riva. Riva biedt containers en Helm-grafieken die speciaal zijn ontworpen om de stappen voor implementatie met één druk op de knop te automatiseren.

Andere bronnen

- NeMo: De belangrijkste opslagplaats voor het NeMo Framework

- NeMo–Loop: Een tool om uw machine learning-experimenten te configureren, starten en beheren.

- NeMo-Aligner: Schaalbare toolkit voor efficiënte modeluitlijning

- NeMo-conservator: Schaalbare toolkit voor datavoorverwerking en -curatie voor LLM's

Neem deel aan de NeMo-community, stel vragen, krijg ondersteuning of meld bugs.

- NeMo-discussies

- NeMo-problemen

Programmeertalen en frameworks

- Python: De belangrijkste interface voor het gebruik van NeMo Framework

- Pytorch:NeMo Framework is gebouwd op PyTorch

Licenties

- De NeMo Github-repository is gelicentieerd onder de Apache 2.0-licentie

- NeMo Framework valt onder de NVIDIA AI PRODUCTOVEREENKOMST. Door de container te downloaden en te gebruiken, gaat u akkoord met de voorwaarden van deze licentie.

- De NeMo Framework-container bevat Llama-materialen die vallen onder de Meta Llama3 Community License Agreement.

Voetnoten

Momenteel wordt er nog gewerkt aan de ondersteuning van NeMo Curator en NeMo Aligner voor multimodale modellen. De ondersteuning zal zeer binnenkort beschikbaar zijn.

Veelgestelde vragen

V: Hoe kan ik controleren of mijn systeem door deze kwetsbaarheid is getroffen?

A: U kunt controleren of uw systeem is getroffen door de versie van het NVIDIA NeMo Framework te controleren. Als deze versie lager is dan versie 24, is uw systeem mogelijk kwetsbaar.

V: Wie heeft het beveiligingsprobleem CVE-2025-23360 gemeld?

A: Het beveiligingsprobleem werd gemeld door Or Peles – JFrog Security. NVIDIA erkent hun bijdrage.

V: Hoe kan ik toekomstige meldingen over beveiligingsbulletins ontvangen?

A: Ga naar de NVIDIA Product Security-pagina om u te abonneren op beveiligingsbulletins en op de hoogte te blijven van beveiligingsupdates voor uw product.

Documenten / Bronnen

| NeMo-framework |

Referenties

- Gebruiksaanwijzingmanual.tools